Pewnie, że Twój asystent AI może umówić się dla Ciebie na spotkanie, ale co z każdą sensowną rozmową? Shutterstock/Bas Nastassia

Pewnie, że Twój asystent AI może umówić się dla Ciebie na spotkanie, ale co z każdą sensowną rozmową? Shutterstock/Bas Nastassia

Google ostatnio odsłonięty jego najnowsza gadająca sztuczna inteligencja, o nazwie Duplex. Duplex brzmi jak prawdziwa osoba, z pauzami, „umms” i „ahhs”.

Gigant technologiczny twierdzi, że może rozmawiać z ludźmi przez telefon, aby umawiać się na spotkania i sprawdzać godziny otwarcia firmy.

W nagranych rozmowach, które były odtwarzane podczas odsłonięcia Google, rozmawiał płynnie z ludźmi po stronie odbiorcy, którzy wydawali się całkowicie nieświadomi, że nie rozmawiają z inną osobą.

Te rozmowy opuściły left publiczność zorientowana na technologię w programie Google wzdycha i wiwatuje. W jednym przykładzie sztuczna inteligencja rozumiała nawet, kiedy osoba, z którą rozmawiała, pomyliła się i była w stanie kontynuować rozmowę i odpowiednio zareagować, gdy powiedziano jej, że nie musi dokonywać rezerwacji.

Powstanie asystentów AI

Jeśli korzystałeś z któregokolwiek z aktualnie dostępnych asystentów głosowych, takich jak Google Home, Siri firmy Apple lub Amazon Echo, ta elastyczność może Cię zaskoczyć. Ci asystenci są notorycznie trudne do wykorzystania w celu innym niż standardowe prośby, takie jak zadzwonienie do kontaktu, odtworzenie utworu, proste wyszukiwanie w Internecie lub ustawienie przypomnienia.

Kiedy rozmawiamy z asystentami obecnej generacji, zawsze zdajemy sobie sprawę, że rozmawiamy z sztuczną inteligencją i często dostosowujemy to, co mówimy, w sposób, który, jak mamy nadzieję, zmaksymalizuje nasze szanse na to, aby to zadziałało.

Ale ludzie rozmawiający z Duplexem nie mieli pojęcia. Wahali się, cofali, pomijali słowa, a nawet zmieniali fakty w połowie zdania. Duplex nie umknął ani chwili. Wydawało się, że naprawdę rozumie, co się dzieje.

Czytaj więcej: Inteligentne głośniki mogą być punktem zwrotnym dla automatyki domowej

Czy przyszłość nadeszła wcześniej, niż ktokolwiek się spodziewał? Czy świat będzie pełen internetowych (i przez telefon) asystentów AI, którzy radośnie rozmawiają i robią wszystko dla nas? Albo co gorsza, czy nagle zostaniemy otoczeni przez inteligentną sztuczną inteligencję z własnymi myślami i pomysłami, które mogą lub nie obejmować nas, ludzi?

Odpowiedź to zdecydowane „nie”. Aby zrozumieć dlaczego, warto przyjrzeć się pod maską, co napędza sztuczną inteligencję, taką jak ta.

Duplex: jak to działa

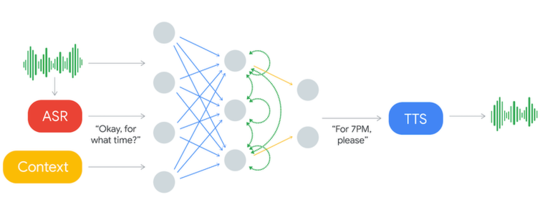

Oto, co Dwustronny system AI wygląda jak.

Dźwięk przychodzący jest przetwarzany przez system ASR. W ten sposób powstaje tekst, który jest analizowany z danymi kontekstowymi i innymi danymi wejściowymi w celu uzyskania tekstu odpowiedzi, który jest odczytywany na głos za pomocą systemu zamiany tekstu na mowę (TTS). Google

Dźwięk przychodzący jest przetwarzany przez system ASR. W ten sposób powstaje tekst, który jest analizowany z danymi kontekstowymi i innymi danymi wejściowymi w celu uzyskania tekstu odpowiedzi, który jest odczytywany na głos za pomocą systemu zamiany tekstu na mowę (TTS). Google

System pobiera „wejście” (pokazane po lewej stronie), czyli głos osoby, z którą rozmawia przez telefon. Głos przechodzi przez automatyczne rozpoznawanie mowy (ASR) i zostaje zamieniony na tekst (słowa pisane). ASR sam w sobie jest zaawansowanym systemem AI, ale typu, który jest już powszechnie używany w istniejących asystentach głosowych.

Tekst jest następnie skanowany w celu określenia rodzaju zdania (takiego jak powitanie, oświadczenie, pytanie lub instrukcja) i wyodrębnienia ważnych informacji. Kluczowe informacje stają się wtedy częścią Kontekstu, który stanowi dodatkowe dane wejściowe, dzięki którym system jest na bieżąco z tym, co zostało powiedziane do tej pory w rozmowie.

Tekst z ASR i Kontekstu jest następnie przesyłany do serca Duplexu, który nazywa się Sztuczną Siecią Neuronową (ANN).

Na powyższym schemacie SSN jest pokazana za pomocą okręgów i łączących je linii. SSN są luźno wzorowane na naszych mózgach, które mają miliardy neuronów połączonych w ogromne sieci.

Jeszcze nie całkiem mózg

SSN są jednak znacznie prostsze niż nasze mózgi. Jedyne, co próbuje zrobić, to dopasować słowa wejściowe z odpowiednią odpowiedzią. ANN uczy się, pokazując transkrypcje tysięcy rozmów osób dokonujących rezerwacji w restauracjach.

Dzięki wystarczającej liczbie przykładów uczy się, jakiego rodzaju zdań wejściowych można oczekiwać od osoby, z którą rozmawia, i jakiego rodzaju odpowiedzi udzielić na każde z nich.

Odpowiedź tekstowa generowana przez SSN jest następnie wysyłana do syntezatora tekstu na mowę (TTS), który przekształca ją na wypowiadane słowa, które są następnie odtwarzane osobie rozmawiającej przez telefon.

Po raz kolejny ten syntezator TTS to zaawansowana sztuczna inteligencja – w tym przypadku jest bardziej zaawansowana niż ta w telefonie, ponieważ brzmi prawie nie do odróżnienia od zwykłego głosu.

To wszystko. Pomimo tego, że jest najnowocześniejszy, sercem systemu jest tak naprawdę tylko proces dopasowywania tekstu. Ale możesz zapytać – jeśli to takie proste, dlaczego nie mogliśmy tego zrobić wcześniej?

Wyuczona odpowiedź

Faktem jest, że ludzki język i większość innych rzeczy w prawdziwym świecie są zbyt zmienne i nieuporządkowane, aby mogły być dobrze obsługiwane przez normalne komputery, ale ten rodzaj problemu jest idealny dla sztucznej inteligencji.

Zwróć uwagę, że dane wyjściowe generowane przez sztuczną inteligencję zależą całkowicie od rozmów, które były pokazywane podczas uczenia się.

Oznacza to, że różne AI muszą być przeszkolone, aby dokonywać rezerwacji różnego rodzaju – na przykład jedna AI może rezerwować restauracje, a druga może rezerwować wizyty u fryzjera.

Jest to konieczne, ponieważ rodzaje pytań i odpowiedzi mogą się bardzo różnić w zależności od rodzaju rezerwacji. W ten sposób Duplex może być o wiele lepszy niż ogólni asystenci głosowi, którzy muszą obsługiwać wiele rodzajów żądań.

Teraz powinno być jasne, że w najbliższym czasie nie będziemy prowadzić swobodnych rozmów z naszymi asystentami AI. W rzeczywistości wszystkie nasze obecne AI to nic innego jak dopasowywanie wzorców (w tym przypadku dopasowywanie wzorców tekstu). Nie rozumieją, co słyszą, na co patrzą lub co mówią.

Dopasowywanie wzorców to jedna rzecz, którą nasze mózgi robią, ale robią też o wiele więcej. Kluczem do stworzenia potężniejszej sztucznej inteligencji może być odblokowanie większej liczby sekretów mózgu. Czy chcemy? Cóż, to jest inne pytanie.![]()

O autorze

Peter Stratton, pracownik naukowy z tytułem doktora, Uniwersytet w Queensland

Artykuł został opublikowany ponownie Konwersacje na licencji Creative Commons. Przeczytać oryginalny artykuł.